Vom 24. - 25.11.2016 diskutierten alle ehemaligen Jahrgänge der Führungskräfteseminare der BAKS das Thema "Künstliche Intelligenz und autonome Maschinen – Auswirkungen auf die Gesellschaft und ihre Sicherheit".

Künstliche Intelligenz verändert die Sicherheitspolitik auf allen Ebenen. Foto: CC0/pixabay

"Die große Gefahr liegt nicht in den intelligenten Maschinen, sondern in den dummen." Gemeint sind nicht etwa explodierende Handy-Akkus oder ausfallende Klimaanlagen in Zügen. Die Rede ist von technischen Geräten, die mit Künstlicher Intelligenz (KI) ausgestattet sind und trotz unausgereifter Technik Einsatz finden könnten. In verschiedenen Vorträgen, Diskussionen und Workshops setzten sich die Teilnehmer und Teilnehmerinnen des diesjährigen Alumnitreffens der Bundesakademie für Sicherheitspolitik mit Fragen nach einer Definition von KI und autonomen Maschinen, dem Stand und der Zukunft der Technik sowie den damit verbundenen ethischen und rechtlichen Aspekten auseinander. Neben der Problematik des Datenschutzes und den gesamtgesellschaftlichen Implikationen der neuen Techniken, wurden auch der militärische Nutzen abgewogen und Kontrollmöglichkeiten von autonomen Waffensystemen diskutiert.

Was sind autonome Systeme und Künstliche Intelligenz?

Autonome Waffen und Maschinen sind kein Novum: Sprengfallen und Selbstschussanlagen können als hochautonom eingestuft werden; sie agieren, einmal installiert, ohne jegliches menschliches Zutun. Sie sind allerdings nicht Gegenstand der aktuellen Debatte. Dies deutet daraufhin, dass der Begriff "Autonomie" einer Klärung bedarf: Autonomie ist zunächst ein menschliches Konzept und bezeichnet die Fähigkeit, selbstständig zu handeln und auch zu entscheiden. In der Übertragung dieses Konzeptes auf Maschinen gibt es bisher keine allgemeingültige Definition. Ist eine Maschine autonom, wenn Sie allein agiert? Oder ist sie auch dann autonom, wenn sie im Austausch mit einem Datenzentrum steht? Ist sie autonom, wenn sie zwar (wie beispielsweise eine Landmine) von Menschen installiert wurde, aber erst zu einem vom Menschen unkontrollierbaren Zeitpunkt ihre Funktion erfüllt? Sollten nur Systeme als autonom eingestuft werden, die kritische Funktionen (wie Zielauswahl und –abschuss) selbstständig erfüllen, oder auch solche, die unterstützende Arbeit leisten? Oder sind unter autonomen Maschinen gar nur solche zu verstehen, mit deren Autonomie ein Risiko einhergeht?

KI zeichnet sich dadurch aus, dass die Entscheidungen, die ein System trifft, nicht im urspünglichen Code vorgegeben sind. Heutige KI und maschinelles Lernen erzeugen komplexe Informationen, nicht jedoch menschliches "Wissen" und Kreativität. Maschinen sind noch weit davon entfernt menschliche Intentionen nachvollziehen oder selbst Intuition nachahmen zu können. Bei den heute vorhandenen Systemen kann man eher von einer "intelligente Programmierung" als von echter "Intelligenz" sprechen.

Militärischer Nutzen heute

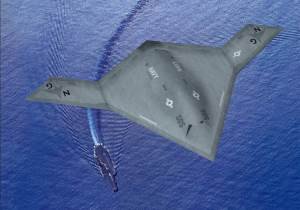

Bereits heute werden bewaffnete und unbewaffnete Drohnen in Kampfeinsätzen verwendet. Der amerikanische Prototyp X47B kann selbstständig starten, navigieren, manövrieren und landen. Im militärischen Einsatz können Drohnen die Bodentruppen im Gefecht unterstützen. Unabhängig davon, ob sie in bemannter oder unbemannter Form eingesetzt werden, bringt die Luftunterstützung Vorteile: Sie schreckt den Gegner ab, liefert ein aktuelles Lagebild und beruhigt die eigenen Soldaten. Im Falle bewaffneter Luftunterstützung ist außerdem ein verzugsloser Waffeneinsatz möglich. Luftunterstützung durch reine Aufklärungsdrohnen birgt dagegen die Gefahr, dass sie im Ernstfall den Luftraum für ein Eingreifen der Artillerie sperren. Aber auch bewaffnete Drohnen können ein Risiko darstellen, wenn es zu Fehleinschätzungen des Piloten kommt. Solche Fehleinschätzungen können unabhängig davon, ob die Drohne von einem Menschen gesteuert wird oder autonom agiert, aus falschen oder verzerrten Informationen entstehen Dies lege nahe, dass autonome Maschinen immer nur komplementär zur Unterstützung von Soldaten Verwendung finden sollten, um Kollateralschäden zu vermeiden. Dies ist vor allem auch deshalb wichtig, weil es in den heute vorherrschenden asymmetrischen Konflikten von besonderer Bedeutung ist, das Vertrauen der lokalen Bevölkerung zu gewinnen.

Roboter wachsen über sich hinaus - "Big Data" machts's möglich. Foto: CC BY-SA 2.0/flickr/Jiuguang Wang

Der "Game Changer"

Für die Entwicklung der Sicherheitspolitik nimmt die Robotik dennoch eine zentrale Rolle als "Game Changer" ein und führt zu wichtigen neuen Trends: Zum einen kehrt sich die traditionelle Rollenverteilung von militärischer und ziviler Entwicklung immer mehr um. Mehr und mehr übernimmt die zivile Forschung die Pionierarbeit für schließlich militärische Verwendungsmöglichkeiten. Des Weiteren bilden die heute weitverbreiteten Assistenzsysteme (zum Beispiel in Fahrzeugen) den Übergang zwischen Fernsteuerung und Autonomie. Dazu findet ein Wandel statt von großen einzelnen Maschinen hin zu vielen kleinen vernetzten Systemen. Und schließlich entwickelt sich das sogenannte "Deep Learning" immer weiter: Mithilfe großer Datenmengen (Big Data) werden Maschinen "angelernt", um so anhand von Statistiken und Wahrscheinlichkeiten Entscheidungen zu treffen, die nicht mehr explizit in ihrem digitalen Code angelegt sind. Nach dem Gesetz der Großen Zahl kann Deep Learning nur mit sehr vielen, gut überprüfbaren Samples funktionieren, wie sie im militärischen Bereich kaum gegeben sind. Deshalb lässt sich Deep Learning nicht für militärische Zwecke verwenden.

Ein Beispiel für Deep Learning wird von Googles "Alpha Go" verkörpert, einem Spielecomputer für das Strategie-Spiel Go, der mithilfe maschinellen Lernens kürzlich den Go-Weltmeister geschlagen hat. Dazu hat Alpha Go eine neue, vorher nicht einprogrammierte Strategie entwickelt – also seine eigene Software umgeschrieben. Für die Entwickler ist nicht nachvollziehbar, auf welche Weise Alpha Go gelernt hat. Dass Computer Algorithmen schreiben, ist nicht neu und der Inhalt neuer Algorithmen durch vorprogrammierte Sicherheitsschranken begrenzt. Was allerdings geschieht, wenn eine KI feststellt, dass diese Sicherheitsschranken einer Problemlösung im Wege stehen, kann nicht vorhergesehen werden.

Das bislang fortschrittlichste vollautonome Waffensystem: Northrop Grumman X-47B. Grafik: CC0/DARPA

Dürfen Roboter töten?

Das Völkerrecht steht heute vor vielfältigen Herausforderungen, von denen der Umgang mit vollautonomen Waffensystemen am meisten umstritten ist. Die entscheidenden völkerrechtlichen und ethischen Fragen sind trotz aller Bemühungen bisher noch ungeklärt: Wie kann man sicherstellen, dass autonome Waffen nicht vorschnell in komplexen Szenarien eingesetzt werden und dabei gegen geltendes Völkerrecht verstoßen? Schließlich müssen völkerrechtlich zulässige Waffen das Völkerrecht auch selbst einhalten. Unabhängig von der völkerrechtlichen Debatte stellt sich außerdem die Frage nach der Menschenwürde: Wollen wir überhaupt, dass Algorithmen über Menschenleben entscheiden? Völkerrechtlich hat man sich bislang auf ein Prüfkriterium geeinigt, das als "meaningful human control" umschrieben wird. Doch weder wie man diese Kontrolle gewährleisten kann, noch was sie beinhalten soll, ist bisher genau definiert.

Das Paradoxon menschlicher Kontrolle über autonome Maschinen

(Präventive) Rüstungskontrolle bei autonomen Waffen ist als höchst unwahrscheinlich einzustufen. Eine solche Kontrolle erfordert zwei Grundvoraussetzungen: Die Staaten müssen erstens prinzipiell zu einer Beschränkung bereit sein und zweitens ihre bisherigen Forschungsergebnisse miteinander teilen. Da insbesondere die zweite Voraussetzung kaum wahrscheinlich ist, erarbeiten die Vereinten Nationen derzeit einen Code of Conduct für die einzelstaatliche Waffenprüfung auf ihre Konformität mit dem Völkerrecht. Allerdings ist fraglich, inwieweit diese Prüfung tatsächlich eine erfolgversprechende Lösung darstellt: Autonome Systeme, die mit KI ausgestattet sind, lernen mit der Zeit und verändern sich. Eine statische Prüfung könnte keine Aussagen über die zukünftige Völkerrechtskompatibilität treffen. Außerdem lässt sich nicht testen, was passiert, wenn zwei KIs verschiedener Staaten aufeinandertreffen sollten. Hinzu kommt, dass eine solche Auseinandersetzung in einer Geschwindigkeit verlaufen würde, dass sie für den Menschen nicht mehr nachvollziehbar ist und der "Stecker nicht mehr rechtzeitig gezogen" werden kann.

Was nehmen wir mit?

Künstliche Intelligenz ist ein Game Changer mit revolutionärem Potential. Die technischen, rechtlichen und ethischen Folgen der damit verbundenen Neuerungen – sowohl bei ziviler, als auch bei militärischer Nutzung – sind bei Weitem noch nicht abschließend erfasst oder gar ausdiskutiert. Ein triftiger Grund für die BAKS, dem Thema auch in Zukunft einen angemessenen Platz im Themenspektrum der Akademie einzuräumen.

Autorin: Vivien Grünkemeier